100 underskrifter nådda

Till: Regeringen

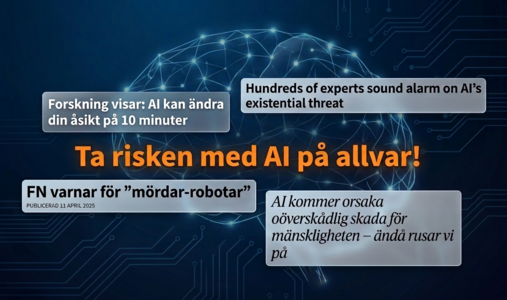

Ta riskerna med AI på allvar!

Politikerna behöver ta riskerna med avancerad AI på allvar.

Sverige behöver trycka på i både FN och EU för att skärpa säkerhetskraven.

Varför är det viktigt?

Utvecklingen av AI går med stormsteg, de flesta experterna tror att vi kommer kunna skapa AI-system som är lika smarta som oss människor redan 2032!

Ledande AI-forskare som Nobelpristagaren Geoffrey Hinton varnar för att det innebär risk att vi tappar kontrollen. Vi har redan sett exempel på hur AI har använts eller uppvisat farligt beteende, risker som förväntas öka i antal och magnitud desto kraftfullare system som byggs.

Ledande AI-forskare som Nobelpristagaren Geoffrey Hinton varnar för att det innebär risk att vi tappar kontrollen. Vi har redan sett exempel på hur AI har använts eller uppvisat farligt beteende, risker som förväntas öka i antal och magnitud desto kraftfullare system som byggs.

Samtidigt slarvar AI-företagen med säkerheten i kapplöpningen om att bli först med riktigt avancerad AI.

Allt fler inser att superintelligens kan vara farligt och AI-forskarna varnar för att det läggs alldeles för lite fokus på AI-säkerhet. Nu behöver politiken lyssna på experterna och ställa krav på säkerhet.

Vi ställer oss bakom kravet att superintelligens inte ska utvecklas förrän vetenskapen är tydlig om att det går att göra säkert!

Allt fler inser att superintelligens kan vara farligt och AI-forskarna varnar för att det läggs alldeles för lite fokus på AI-säkerhet. Nu behöver politiken lyssna på experterna och ställa krav på säkerhet.

Vi ställer oss bakom kravet att superintelligens inte ska utvecklas förrän vetenskapen är tydlig om att det går att göra säkert!

Mer information: https://pauseai.se/